Fin octobre 2014, Google annonce une mise à jour des consignes techniques pour webmasters, suite à une modification du système d’indexation. Qui dit indexation, dit crawl, pour pouvoir indexer, le moteur doit pouvoir crawler pour calculer, comparer et analyser. Cette avancée remet en cause la cécité de Google !

Aujourd’hui on ne peut plus dire que la vue de Google se compare à un affichage avec un navigateur de 1re génération type Lynx, Google a recouvré la vue, et voit désormais les pages dans leur ensemble, telles qu’elles s’affichent dans un navigateur « moderne ».

Voilà ce qu’indique Google sur le Blog Officiel pour les webmasters

Pour optimiser l’affichage et l’indexation de vos pages et de votre site, vous devez désormais autoriser l’accès de Googlebot aux fichiers JavaScript, CSS et image que vous utilisez.Le blocage de l’exploration des fichiers JavaScript ou CSS dans le fichier robots.txt de votre site nuit directement à la qualité de l’affichage et de l’indexation de votre contenu par nos algorithmes. Cela peut avoir un impact négatif sur le classement de votre site.

Quelques vérifications sont à prévoir

Robots.txt

Pour avoir le rendu de votre page, Google a désormais besoin d’un accès à vos scripts et fichier CSS.

Suivant le CMS que vous utilisez, il est possible que vous bloquiez l’accès à ces fichiers. Effectivement certains systèmes de gestion de contenu fournissent un fichier robots.txt par défaut et de nombreux répertoires sont interdits d’accès au crawl, ce qui va vite poser un problème à Google qui ne pourra avoir le rendu de vos pages sur les différents supports.

Par exemple, Drupal va bloquer l’accès aux répertoires script, thème. Joomla va bloquer l’accès des répertoires : templates, components, modules et plugins. Or ces dossiers contiennent pourtant des infos pour Google.

Il faut donc vous pencher sur votre fichier robots.txt et le personnaliser.

– Bloquer l’accès uniquement aux pages et répertoires qui ne contiennent pas de fichiers jouant sur l’affichage du site.

– Consulter les outils pour webmasters de google pour avoir des informations plus précises sur les éventuels problèmes rencontrés ou ressources bloquées au crawl.

Vous trouverez ces informations sur la partie : Traffic de recherche > Compatibilité mobile

Ainsi que sur Exploration > Explorer comme Google, où vous pourrez tester l’affichage de vos pages telles qu’elles sont affichées pour le moteur.

Thème de votre CMS et fonctionnalité

Veillez également à n’utiliser que des fonctionnalités, ad-dons, modules, plugins qui sont utiles pour votre site.

Nous rencontrons fréquemment des thèmes WordPress préconçus avec la possibilité d’utiliser le plugin Woocommerce sur des sites corporates, avec pourtant toutes les références à Woocomerce dans les sources avec des appels de script ou css.

Maintenant que Google va aller analyser tous vos fichiers js et css, faites en sorte d’améliorer le crawl et de garder le moteur sur des ressources qui vous sont vraiment utiles.

Pensez donc à nettoyer vos templates de toutes références inutiles à des ressources non utilisées et à grouper un maximum vos scripts et css.

Vous gagnerez en temps de réponse pour vos pages tout en augmentant la qualité du site aux yeux du moteur.

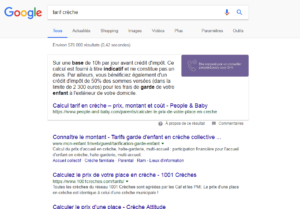

Google ne veut pas indexer mais explorer = voir sans mémoriser !

Enfin certaines personnes semblent inquiètes de laisser Google crawler les répertoires « système » de leur CMS…. « Quoi laisser Google indexer mes fichiers top secrets! Mes sources jusqu’à mes CSS !! Où est ma propriété intellectuelle ! Je ne veux pas que tout le monde puisse copier mon site… si je laisse Google crawler mes pages d’administration, elles vont être indexées et tout le monde pourra rentrer sur mon back office …. »

Pas de panique ! crawl ne veut pas nécessairement dire indexation, le crawl c’est la lecture, l’indexation le stockage.

Ce n’est pas parce que vous ne bloquer pas le répertoire admin du site que google va aller indexer vos fichiers php ou vos css. Combien de site n’ont même pas de robots.txt et pourtant leurs contenus ou les pages de leur back office ne sont pas indexés.

Google le précise très bien dans sa petite phrase : « Le blocage de l’exploration des fichiers JavaScript ou CSS dans le fichier robots.txt de votre site nuit directement à la qualité de l’affichage et de l’indexation de votre contenu par nos algorithmes », Indexation du CONTENU, les fichiers php, js ou css ne sont pas du contenu.

Si vous avez les logs de votre site, vous pourrez d’ailleurs vérifier que les moteurs SEARCH (google, bing etc.) ne vont pas chercher à indexer les pages d’admin. Ces pages ont généralement la meilleure protection possible pour éviter que les moteurs entrent c’est un login et un mot de passe.

Besoin d’un conseil ou d’une vérification ? vous souhaitez savoir si les moteurs vont crawler la partie d’administration de votre site ? Contactez-nous.

Article très intéressant, je n’étais pas au courant de ce changement d’algorithme.

Une remarque, toutefois, concernant Drupal, les dossiers cités doivent rester cachés.

Sur un site conçu correctement, tout ce qui concerne les thèmes se situe dans le dossier /sites et surtout pas dans le dossier /scripts.

Le dossier /themes quant à lui ne devrait pas contenir le thème personnalisé.

merci @philippe pour votre commentaire, ou je note 4 mots importants : un site conçu correctement (..) Effectivement l’article est parti d’un site pas très conventionnel qui bloquait par défaut google, j’en ai fait une généralité ! Je maintient pour Joomla quand même 😉